En el panorama digital actual, la integración de herramientas de inteligencia artificial de tipo GenAI (Generative AI) se ha convertido en la norma en una amplia gama de industrias. Estas herramientas permiten a las organizaciones optimizar procesos, mejorar la eficiencia y desbloquear nuevas vías de innovación. Sin embargo, junto con los beneficios potenciales, surge la necesidad de que las empresas ejerzan una supervisión meticulosa de las herramientas de GenAI utilizadas en su entorno.

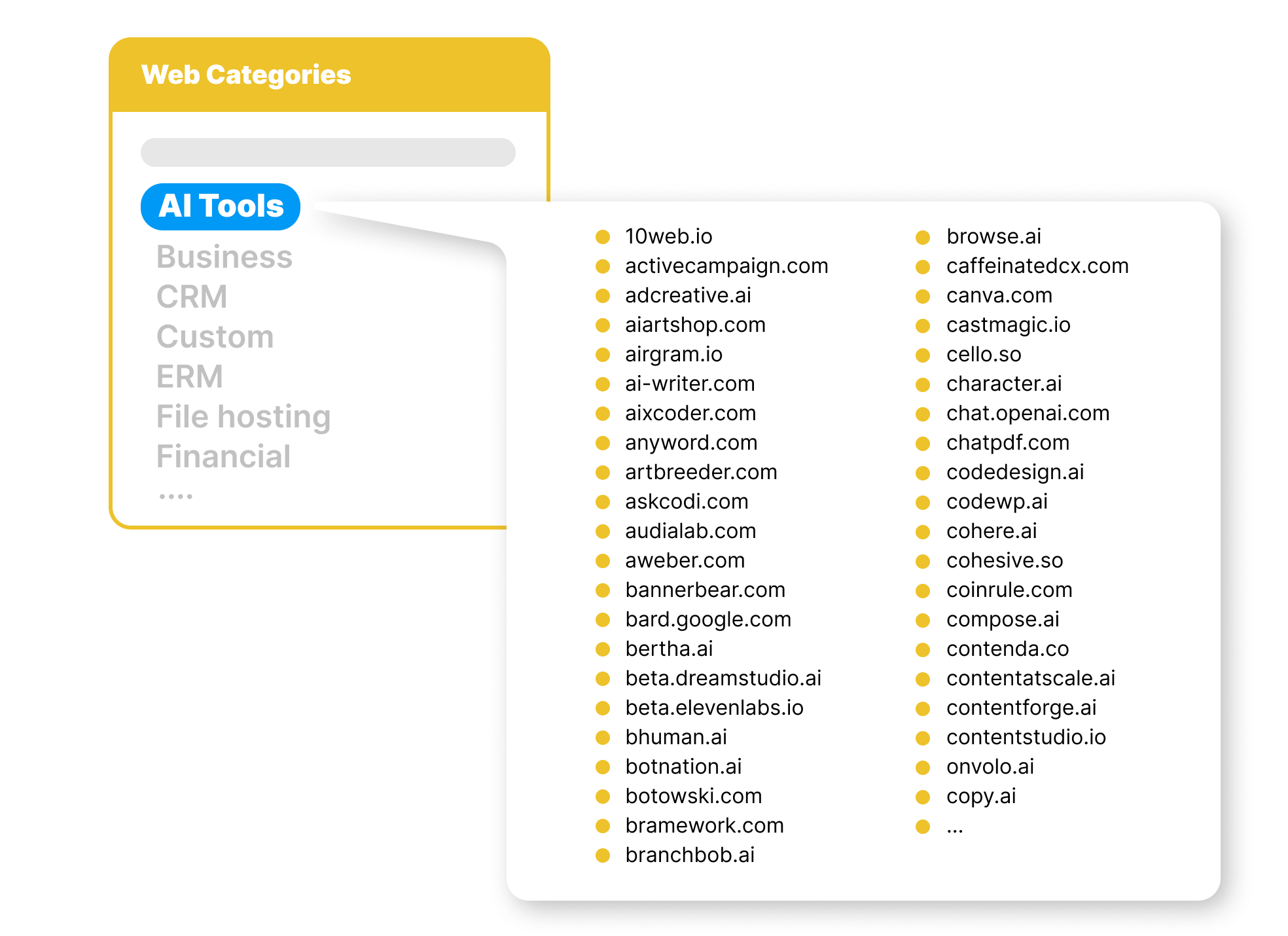

Safetica utiliza dos enfoques para gestionar el uso de estas herramientas dentro de una organización. Estos enfoques clasifican los sitios web relacionados con las herramientas GenAI y proporcionan distintas formas de monitorear y controlar el uso.

Bloqueo proactivo

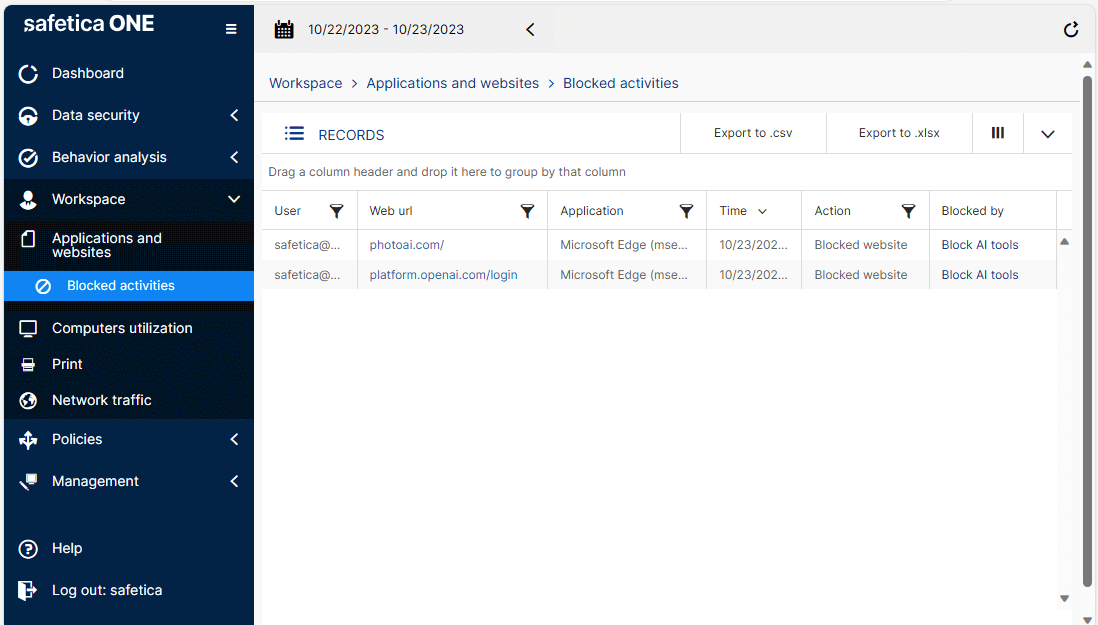

Safetica ONE adopta una postura proactiva en la gestión del uso de herramientas GenAI. Cuando un usuario visita un sitio web categorizado como herramienta GenAI, inmediatamente indica que se ha utilizado una herramienta GenAI dentro de la empresa. Esta transparencia permite a las organizaciones mantenerse informadas sobre las herramientas de sus empleados y promueve un uso responsable.

Además, Safetica ONE puede bloquear el acceso a estos sitios web con sólo unos pocos clics. Si una empresa considera que determinadas herramientas GenAI son incompatibles con sus operaciones, puede restringir rápidamente el acceso, garantizando el cumplimiento de sus políticas de seguridad de datos.

Evaluación de riesgos y conocimiento del comportamiento del usuario

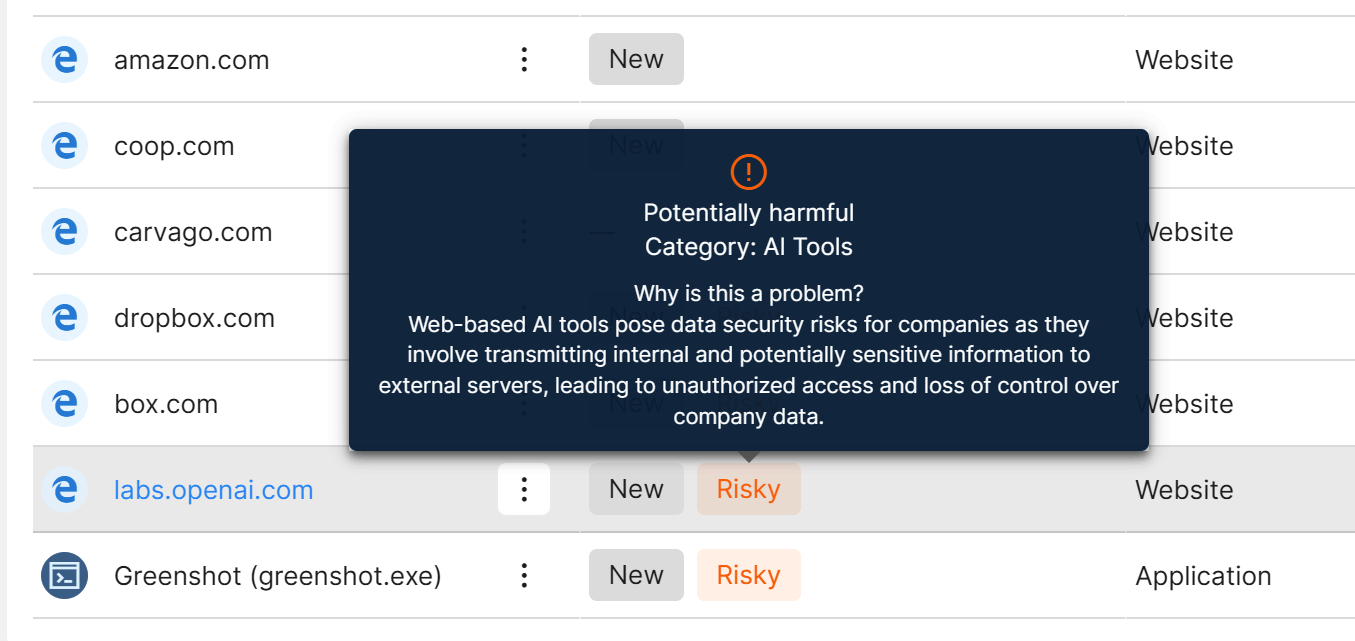

Safetica NXT, nuestra DLP basada en la nube, adopta un enfoque basado en riesgos para la gestión de herramientas GenAI. Reconoce que visitar sitios web relacionados con herramientas GenAI puede representar un riesgo potencial para una organización. Si bien no ofrece la función de bloqueo que ofrece el enfoque proactivo, se destaca por brindar información detallada sobre la actividad web de los usuarios.

Cuando un empleado visita un sitio web relacionado con la herramienta GenAI, Safetica NXT lo identifica como una actividad web riesgosa. Esta categorización luego se visualiza como un problema dentro del entorno. Este sistema permite a las organizaciones rastrear comportamientos potencialmente riesgosos, proporcionando una base para futuras investigaciones o iniciativas de capacitación.

Además, Safetica comprende que no todo el uso de herramientas de inteligencia artificial es inherentemente dañino. Distingue entre el uso genuino para fines relacionados con el trabajo y posibles violaciones de seguridad, ofreciendo una comprensión más matizada de la situación.

Gestionar eficazmente el uso de herramientas de Inteligencia Artificial dentro de una organización es crucial para mantener la seguridad de los datos y el cumplimiento de las regulaciones de la industria. DLP ofrece distintos enfoques y brinda a las empresas las herramientas para tomar decisiones informadas sobre la integración de herramientas GenAI.

Al aprovechar las capacidades de visualización y bloqueo proactivo o evaluación de riesgos de Safetica, las organizaciones pueden mejorar su postura de seguridad de datos y garantizar el uso responsable de herramientas de Inteligencia Artificial en el lugar de trabajo. Con la estrategia adecuada, las empresas pueden aprovechar con confianza el poder de las herramientas GenAI y, al mismo tiempo, proteger la información confidencial.

Para obtener más información sobre cómo Safetica puede ayudar a reducir el riesgo de las herramientas GenAI en su organización, agenda una demo